AI Inference

Preview

Ejecuta inferencia de IA para LLMs, VLMs y modelos multimodales con baja latencia, usando una API compatible con OpenAI, infraestructura distribuida y sin gestionar clústeres de GPU.

Más rápido en inferencia

% menor en costos de cómputo

% menor en latencia

Reduce la latencia de inferencia

La ejecución distribuida mantiene respuestas rápidas, con bajo time-to-first-token y menor latencia de extremo a extremo.

Escalado serverless sin operaciones de GPU

Maneja demanda variable sin provisionar clusters de GPU. Escala automáticamente desde la primera solicitud hasta el pico de carga, manteniendo costes alineados con el uso.

Confiable por diseño para workloads de producción

El failover automático mantiene la inferencia mission-critical disponible, incluso durante picos de tráfico o fallas regionales.

"Con Azion, podemos escalar nuestros modelos de IA propietarios sin tener que preocuparnos por la infraestructura. Estas soluciones inspeccionan millones de sitios web diariamente, detectando y neutralizando amenazas con rapidez y precisión, realizando el takedown más rápido del mercado."

Fabio Ramos

CEO

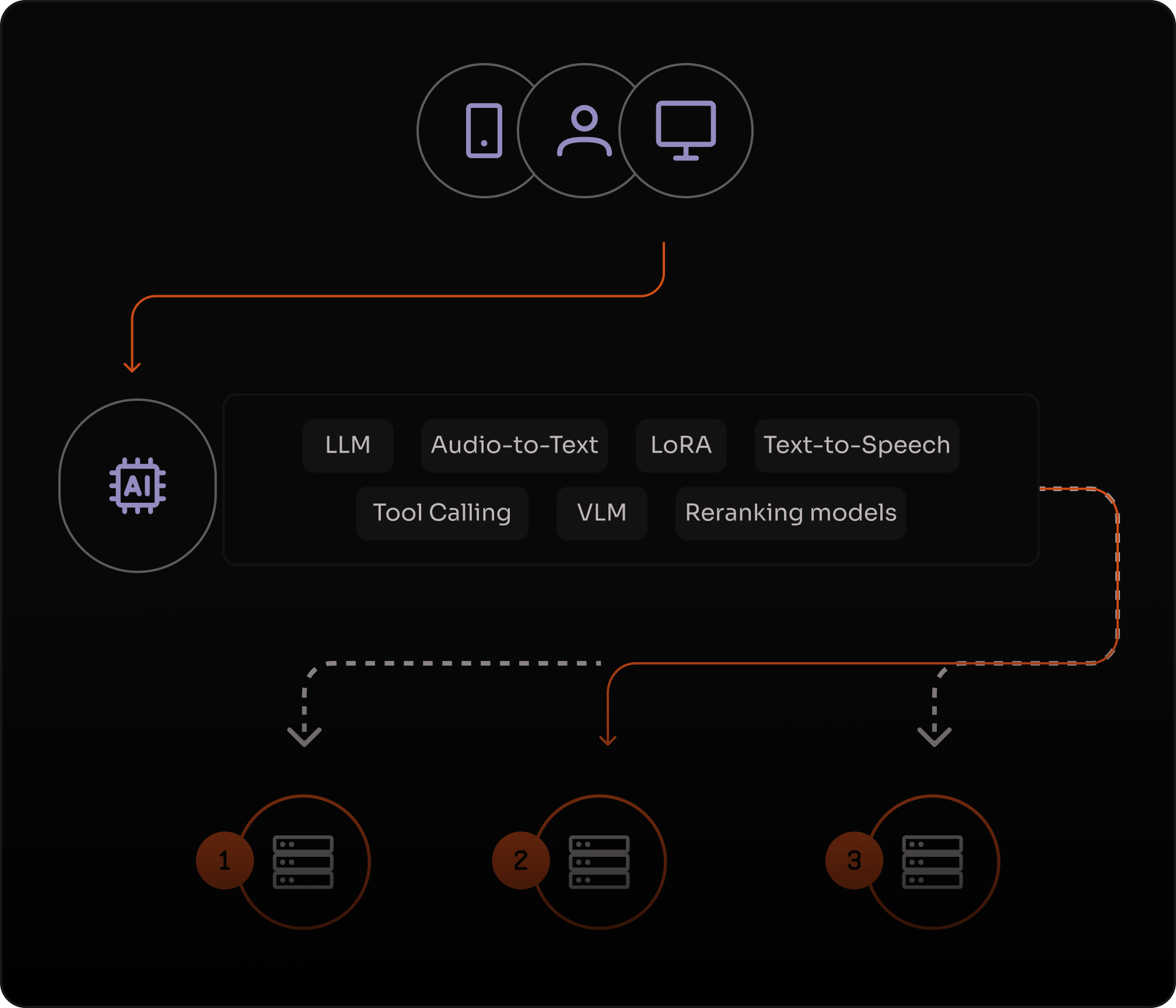

Construye, personaliza y sirve modelos de AI en producción

Despliega y ejecuta LLMs, VLMs, Embeddings, Audio a Texto, Texto a Imagen, Tool Calling, LoRA, Rerank y LLMs de codificación — todo integrado con aplicaciones distribuidas.

LLMs & VLMs Integración Functions Compatible con OpenAI Auto-scaling

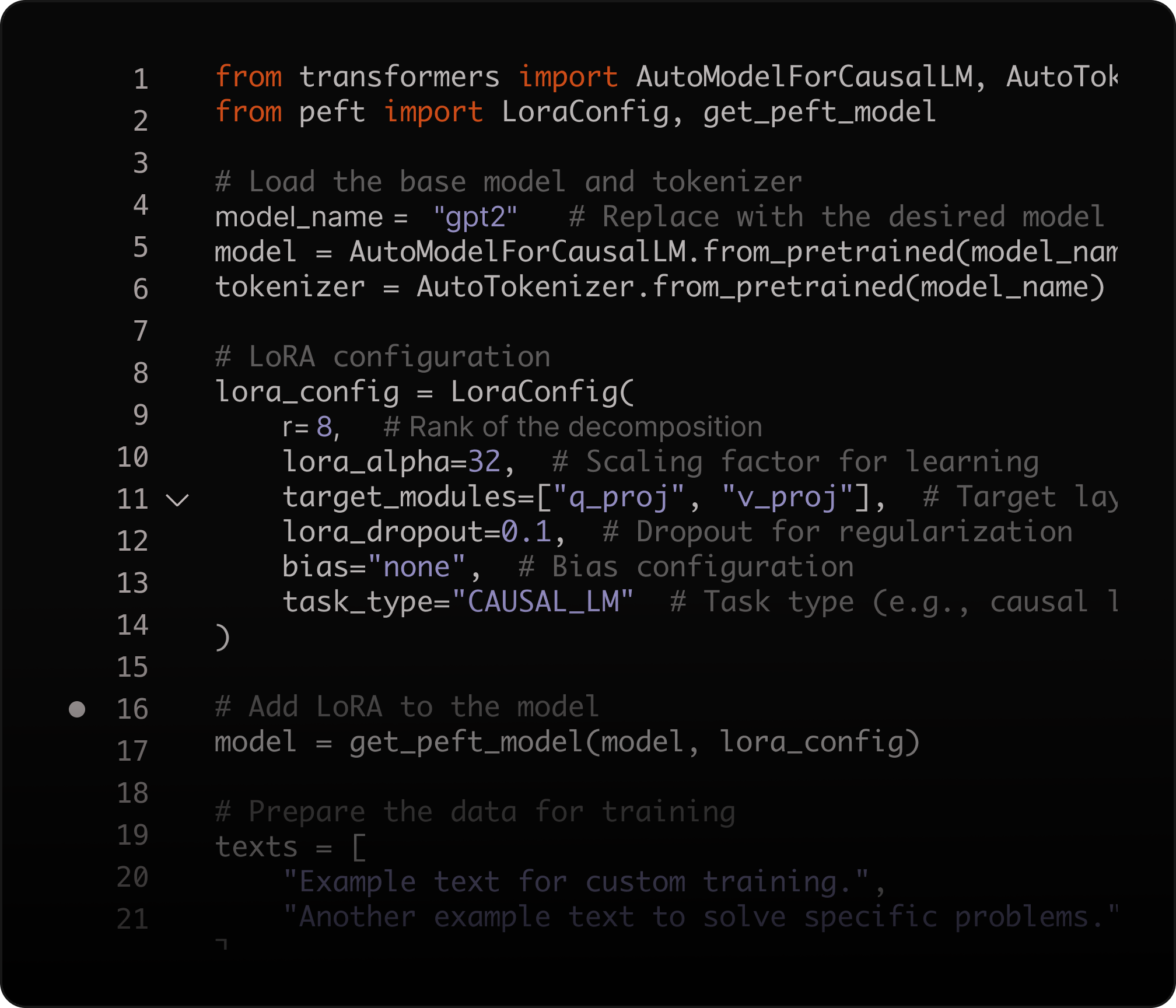

Fine-tune con LoRA para rendimiento específico de dominio

Adapta las salidas del modelo a tu dominio usando Low-Rank Adaptation (LoRA), mejorando la precisión mientras reduces costos de cómputo.

Fine-tuning LoRA Personalización de dominio Sin reentrenamiento completo Menor coste de cómputo

Qué puedes construir con AI Inference

Preguntas Frecuentes

¿Qué es Azion AI Inference?

Azion AI Inference es una plataforma serverless para desplegar y ejecutar modelos de AI globalmente. Características principales incluyen: API compatible con OpenAI para migración fácil, soporte a LLMs, VLMs, embeddings y reranking, escalado automático sin gestión de GPU, y ejecución distribuida de baja latencia. Crea endpoints de producción e intégralos en Applications y Functions.

¿Qué modelos puedo ejecutar?

Puede elegir de un catálogo de modelos de código abierto disponibles en AI Inference. El catálogo incluye diferentes tipos de modelos para cargas de trabajo comunes (generación de texto y código, vision-language, embeddings y reranking) y evoluciona a medida que nuevos modelos están disponibles.

¿Es compatible con la API de OpenAI?

Sí. AI Inference soporta un formato de API compatible con OpenAI, por lo que puede mantener sus SDKs de cliente y patrones de integración y migrar actualizando la URL base y las credenciales. Consulte la documentación del producto: https://www.azion.com/en/documentation/products/ai/ai-inference/

¿Puedo hacer fine-tuning de modelos?

Sí. AI Inference soporta personalización de modelos con Low-Rank Adaptation (LoRA), para que pueda especializar modelos de código abierto para su dominio sin reentrenamiento completo. Guía inicial: https://www.azion.com/es/documentacion/productos/guias/ai-inference-starter-kit/

¿Cómo construyo RAG y búsqueda semántica?

Use AI Inference con SQL Database Vector Search para almacenar embeddings y recuperar contexto relevante para Retrieval-Augmented Generation (RAG). Esto permite patrones de búsqueda semántica y búsqueda híbrida sin infraestructura adicional.

¿Puedo construir AI agents y workflows con tool-calling?

Sí. AI Inference puede usarse para alimentar patrones de agentes (por ejemplo, ReAct) y workflows con tool-calling cuando se combina con Applications, Functions y herramientas externas. Azion también proporciona plantillas y guías para agentes basados en LangChain/LangGraph.

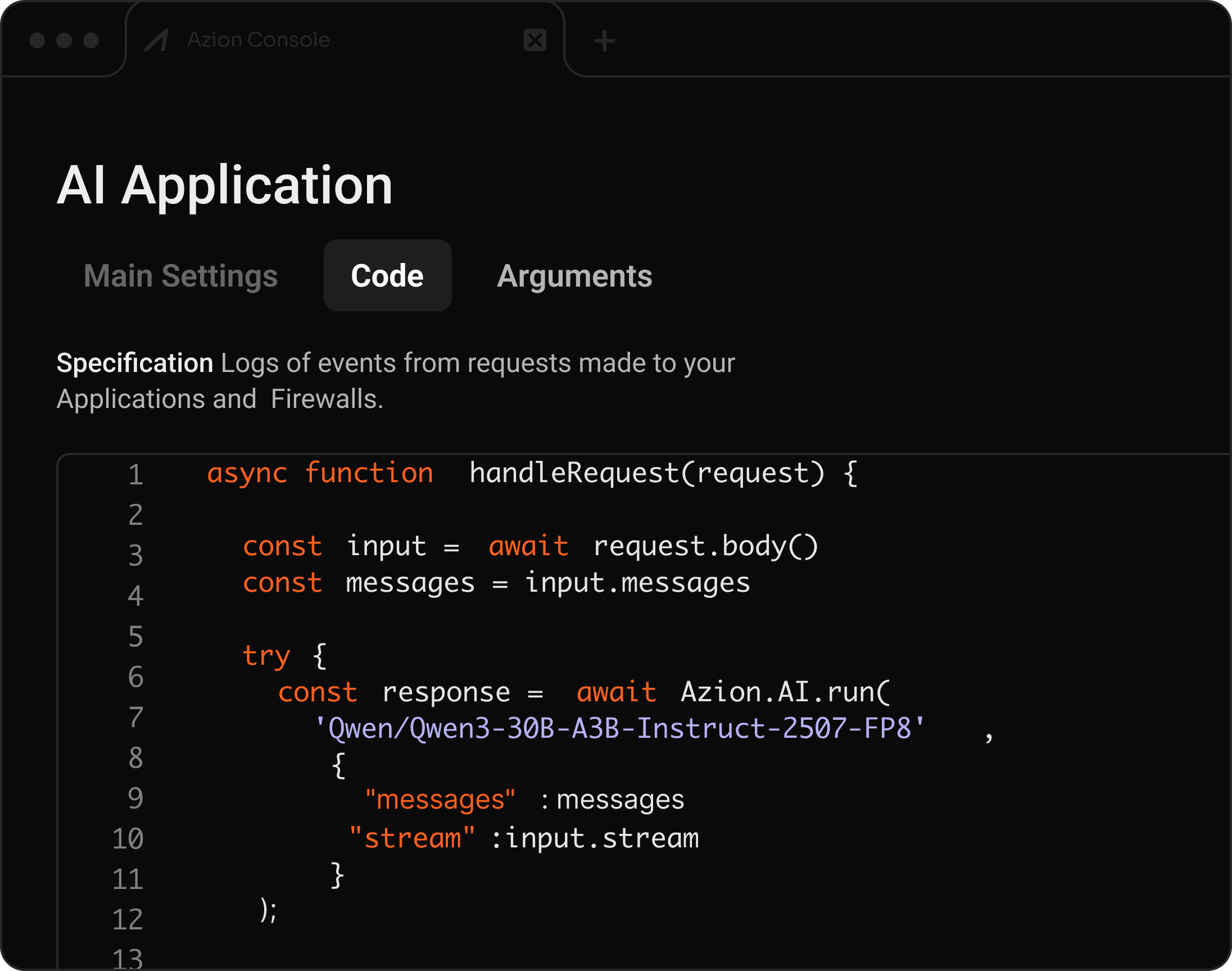

¿Cómo despliego AI inference en mi aplicación?

Cree un endpoint de AI Inference e intégrelo en su flujo de solicitudes usando Applications y Functions. Esto le permite agregar capacidades de AI a APIs existentes y experiencias de usuario con ejecución distribuida y escalado gestionado.

Acceso a todos los productos.